Dal 2022 a oggi l’interesse per il termine “AI” è aumentato del 2500% (Google Trend) ma, nonostante questo argomento mi stia molto a cuore, ho sempre preferito non esprimermi a riguardo, sia perchè non reputavo di avere molto di rilevante da aggiungere, sia perchè, sia su Linkedin che sul nome di quotidiano di paese, il rapporto rumore/segnale è già abbastanza alto.

Solo recentemente tuttavia, dopo qualche discussione e spunto interessante, anche per cercare di fissare la mia opinione per vedere se e come evolverà nei prossimi mesi anni, ho pensato fosse buona cosa mettere per iscritto le mie preoccupazioni e speranze legate all’intelligenza artificiale.

Datemi una leva e vi solleverò il mondo (Archimede)

Utilizzare l'AI significa, almeno nelle attività in cui sono coinvolto, andare in leva con il proprio tempo e il proprio impegno; in altre parole, l'AI è uno strumento di amplificazione del nostro output.

Nonostante a volte mi manchi sbattere la testa su problemi intricati ma di bassissimo livello (vedi scrivere funzioni Python a mano, ricercare informazioni nascoste o perdere tempo a risolvere equazioni o integrali), sono convinto che gli attuali modelli AI rendano accessibili e fattibili progetti prima impensabili, non solo permettono di non perdere tempo su problemi di basso livello, ma lavorando a un livello di astrazione maggiore e focalizzandosi maggiormente sil design e l’output da raggiungere.

La mia preoccupazione al riguardo è che, avendo a disposizione risorse computazionali "quasi infinite" a costo bassissimo, si rischia di non effettuare un’analisi costi/benefici di un progetto (essendo i costi quasi nulli). Si finisce così per iniziare o implementare, “solo per il gusto di farlo”, cose che non sempre servono o che hanno utilità marginale decrescente (capita spesso, per esempio, di sviluppare un prototipo, un’idea o scrivere qualcosa e, solo in un secondo momento, chiedersi quanto effettivamente sia utile e rilevante).

La stessa perplessità si applica al recente trend di voler costruire "agent" per ogni attività: abbiamo davvero bisogno di automatizzare tutto? Quante volte questo è giustificato da un output qualitativamente superiore rispetto a quello umano, e quante volte si tratta di un puro show-off o del riflesso di pigrizia mentale?

Avere infatti a disposizione uno strumento potentissimo non implica il doverlo sfruttare in ogni circostanza: sono convinto che, ancora in molti casi, l’utilizzo della GenAI sia un overkill e una forzatura inutile dettata dal trend del momento e che, con le dovute competenze necessarie, soluzioni old-school puramente algoritmiche o, ancora “peggio”, soluzioni puramente human-based siano ancora qualitativamente superiori.

Se ti concentri e guardi con attenzione, tutto si chiarisce da sé (Haruki Murakami)

La mia più grande paura non è che l'AI ci tolga il lavoro, bensì che ci tolga la capacità di concentrarci su un problema complesso per lunghi periodi di tempo. Costruire qualcosa, risolvere problemi strutturati e scrivere testi elaborati sono tutte attività che richiedono tempo e fatica mentale (motivo per cui su questo blog non è ancora presente un testo generato da zero dall'AI).

Tuttavia, grazie all'utilizzo di soluzioni AI più o meno complesse (dall'LLM nella versione gratuita a costosi agent ad-hoc), tutto questo si traduce spesso in prompt di qualche riga, scritti con grammatica e sintassi imprecise e senza troppa riflessione dietro, speranzosi che il modello in qualche modo “capisca” le nostre intenzioni e sputi vuoi qualcosa di rilevante.

Si perde tutta la parte di analisi e scomposizione del problema, deep dive e fatica associata, finendo, nella maggior parte dei task, per essere soddisfatti dell’output istantaneo ma accontentandosi di un risultato mediocre o, peggio, che non ci appartiene o non rispecchia in dettaglio la natura del problema.

Anche per questo motivo non mi sento di paragonare la richiesta a un LLM a una ricerca su Google: mentre la prima è istantanea e puramente “passiva”, un motore di ricerca richiede di scegliere, verificare e analizzare ogni fonte.

Non penso, tuttavia, che questo sia l’unico modo di interagire con l’AI. È infatti ancora possibile affiancare (e farsi aiutare) il proprio lavoro con GPT, Gemini o Grok: entrando insieme al modello in una situazione di deep work, avendo chiaro il problema macroscopico e scomponendo in task minori da delegare, facendo brainstorming, ricercando informazioni rilevanti più velocemente e, soprattutto, mettendo sempre sotto stress le proprie convinzioni grazie alla loro enorme capacità di analisi.

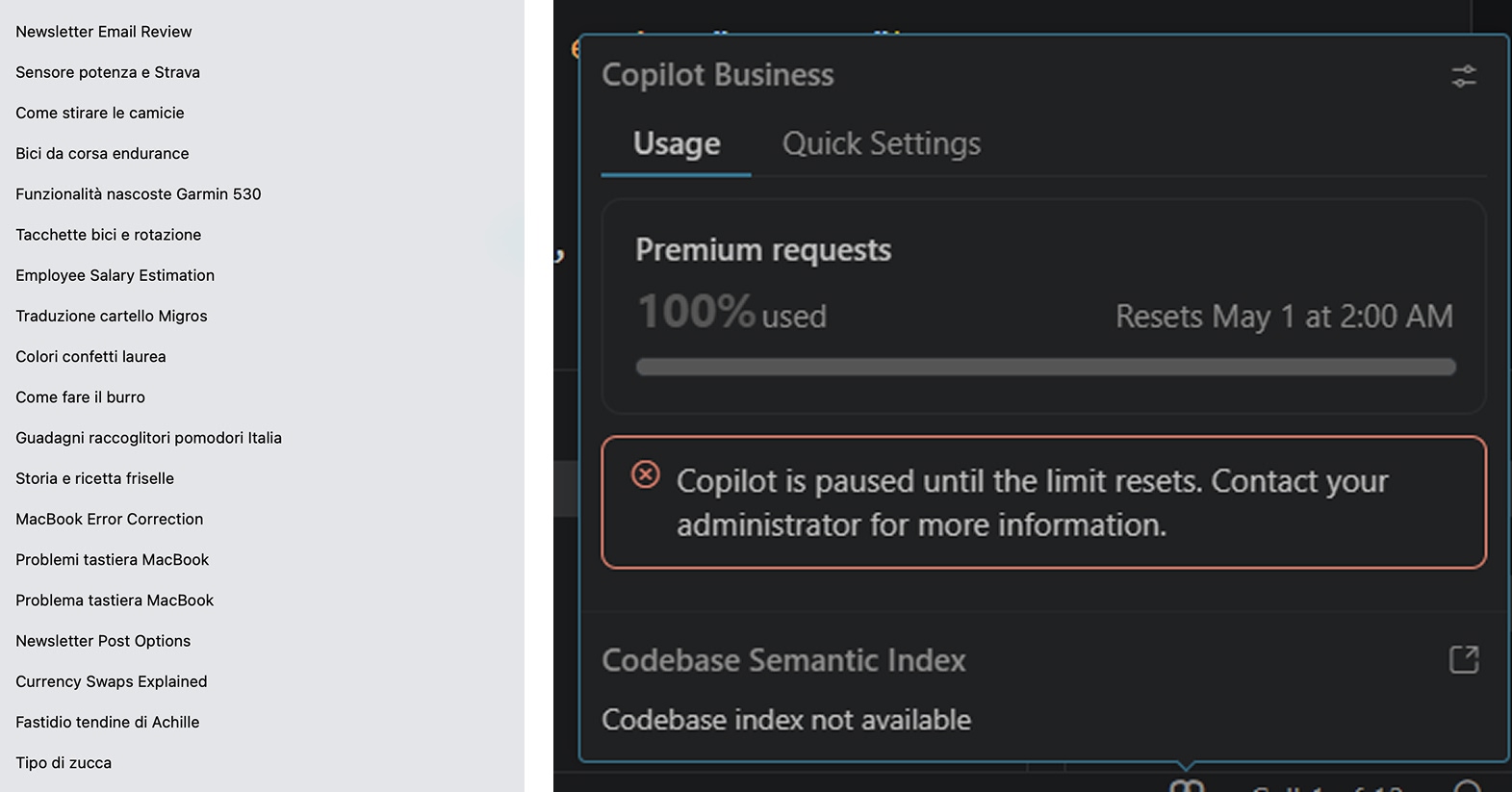

Ho notato infatti che, in molti casi, l'obiettivo primario non è più ottenere un output della massima qualità, bensì massimizzare il rapporto risultato/fatica o, ancora peggio, minimizzare lo sforzo compiuto: finalità per cui, purtroppo, gli LLM si prestano benissimo.

Inoltre, nelle attività le cui finalità sono path-dependent (in primis lo studio), l'utilizzo dell'AI risulta spesso controproducente. Nonostante non voglia sembrare contrario all'AI nella didattica (e utilizzando io per primo Gemini per aiutarmi a studiare) nelle attività in cui è richiesto uno sforzo mentale vero e proprio cerco ancora di utilizzarla il meno possibile.

Ci sono task per cui sono ben contento di risparmiare del tempo (tradurre e correggere email, formattare testi, recuperare informazioni specifiche online) e attività in cui sono felice di avere una produttività "sub-ottimale" pur di spenderci qualche ora in più (motivo per cui sono grato di aver svolto la maggior parte della mia istruzione prima dell’uscita di GPT-2 nel 2019 e per cui sono pienamente di prendere appunti “manualmente”, nonostante Gemini possa farlo in qualche secondo a partire dalle mie slide).

Sebbene risolvere integrali, scrivere manualmente codice Python ed estrarre segnale da testi complessi siano ormai attività facilmente delegabili a un'AI, sono convinto che il processo tramite cui si arriva al risultato sia fortemente formativo e permetta di attivare parti del nostro cervello (nel caso sono pronto a farmi smentire dalle neuroscienze) fondamentali per lo sviluppo delle capacità di problem solving.

L'AI sta infatti eliminando dalle nostre vite, in modo progressivo e spesso subdolo, tutte le occasioni in cui compiere fatica mentale e prendere scelte è necessario. Anche se in alcuni casi questa fatica può essere fine a se stessa e senza un risvolto direttamente positivo, non mi piace l'idea di una quotidianità in cui non è più richiesto pensare ai problemi, farsi mille conti per valutare delle alternative o iterare più volte su una stessa soluzione prima di arrivare a un risultato convincente.

Compiti a casa, teoremi e formaggio ammuffito

Quello che mi preoccupa maggiormente di tutto ciò è l'impatto a lungo termine sull'istruzione primaria e secondaria. AI e didattica viaggiano a velocità nemmeno lontanamente paragonabili: se da un lato ogni pochi mesi viene rilasciato un nuovo modello più performante e capace di affrontare problemi lunghi e complessi, i metodi di insegnamento sono purtroppo rimasti indietro, facendosi cogliere impreparati da questa rivoluzione (l’80% degli studenti US dichiara di utilizzare l’AI a scuola, ma solo il 50% delle istituzioni ha regole a riguardo e solo il 6% di queste regole sono chiare, fonte Staford AI report). Sono infatti convinto che, almeno fino agli ultimi anni di scuola superiore, un modello di frontiera (2026) sia in grado di overperformare anche gli studenti più brillanti.

La conseguenza più ovvia (e disastrosa) è che ogni studente è perfettamente consapevole che ogni problema assegnatogli a scuola è facilmente risolvibile in pochi click e, potenzialmente ogni difficoltà può essere "aggirata" con una foto al compito e un prompt di poche righe. A ciò si aggiunge il fatto che non viene insegnato un metodo per utilizzare questi nuovi strumenti, i quali, visto il loro enorme potenziale, richiedono una minima conoscenza di base per essere sfruttati al meglio.

Trovo però che, nonostante io sia molto bearish riguardo al rapporto a brevissimo termine tra istruzione e AI, non si possa negare che in questo campo l'AI resti una risorsa rivoluzionaria, almeno quanto l'invenzione della stampa o di Wikipedia. Mi stupisco infatti di quanto sia incredibile avere accesso a una conoscenza (quasi) illimitata in maniera istantanea, nelle modalità che preferisco e a tutti i livelli di "superficialità" o approfondimento desiderati (dal chiedersi di spiegare passo-passo la dimostrazione di un teorema matematico al chiedere che cosa fare quando parmigiano è ammuffito).

Zurigo ha più agent-AI che abitanti

Sebbene questa risorsa sia, almeno per me, accessibile a costo e sforzo zero, sono ben consapevole di trovarmi in una bolla. Da qualche mese vivo a Zurigo, la città con la più grande densità di talento in ambito AI ma, a prescindere da ciò, trascorro le mie giornate in un contesto molto giovane, favorevole e abituato al progresso tecnologico e lavoro felicemente in un'azienda che (pur essendo quanto di più lontano da una startup governata da ventenni in t-shirt e Patagonia ) sta fieramente spingendo forte sull'adozione di questi strumenti.

Sono però conscio che il mondo viaggi su binari ben diversi: anche tra i ragazzi della mia generazione l'utilizzo e la conoscenza degli LLM restano molto limitati, l'adozione in ambienti didattici spesso non è nemmeno considerata (e tantomeno accettata) e non tutte le aziende stanno cercando modalità per sfruttare al meglio questa tecnologia. Perlopiù, la sua diffusione dipende strettamente dal settore di riferimento: il software engineering è stato certamente l'ambito più rivoluzionato e, in generale, tutte le materie STEM ne hanno sentito fortemente gli effetti positivi. Non tutti però i lavori "intellettuali" (tralasciando chiaramente muratori e cuochi che, almeno per il momento, sono al sicuro!) sono interessati allo stesso modo e, di conseguenza, gli adetti ai lavori sono molto meno coinvolti e toccati da questa rivoluzione.

OpenAI è ancora una no-profit

La mia ultima preoccupazione riguarda però un'altra bolla: quella legata alla natura economica e finanziaria dietro questo trend. Non metto in discussione le capacità di Claude Opus 4.7 o GPT-5, bensì resto perplesso su quanto tutto questo sia economicamente sostenibile, sia per le aziende dietro i grandi modelli, sia per le aziende terze che stanno investendo nella loro adozione e, in ultima parte, per noi consumatori finali dato che, al momento, tutta questa grande rivoluzione si fonda su aziende che fanno acqua da tutte le parti.

OpenAI, nonostante i suoi 900 milioni di utenti (di cui solo il 5% pagante!), prevede di chiudere il 2026 in rosso con 14 miliardi di dollari di perdite (Yahoo Finance) e, sempre secondo le stime, aumentando il proprio passivo fino al 2029. Le previsioni per Anthropic, più orientata a un modello enterprise che B2C, sono leggermente migliori (con un cash flow previsto in positivo già nel 2028) ma comunque, almeno al momento, restano in rosso. Gioca una partita simile xAI (la società di Musk dietro a Grok) che, secondo gli analisti, brucia più di un miliardo a trimestre.

Come mi suggerisce Gemini stesso chiedendogli di estrarre delle battute "di cattivo gusto" da questa situazione, la Gen-AI assomiglia quindi al più grande esperimento di socialismo della Silicon Valley: i ricchi mettono i soldi e il popolo usa i modelli per non leggere i libri e lavorare di meno.

Scherzi a parte, i meccanismi di finanziamento circolare tra fornitori tecnologici e scale-up AI rappresentano un altro elemento di preoccupazione. Il pattern, ormai validato più volte da molteplici Big Tech, prevede infatti che un fornitore di infrastruttura hardware/software (leggi NVIDIA per le schede video, Microsoft per l'infrastruttura Cloud) fornisca capitale a un'azienda esterna (leggi OpenAI) che, con gli stessi fondi, compra servizi o prodotti dal suo stesso finanziatore, gonfiando le metriche finanziarie e di crescita da entrambe le parti.

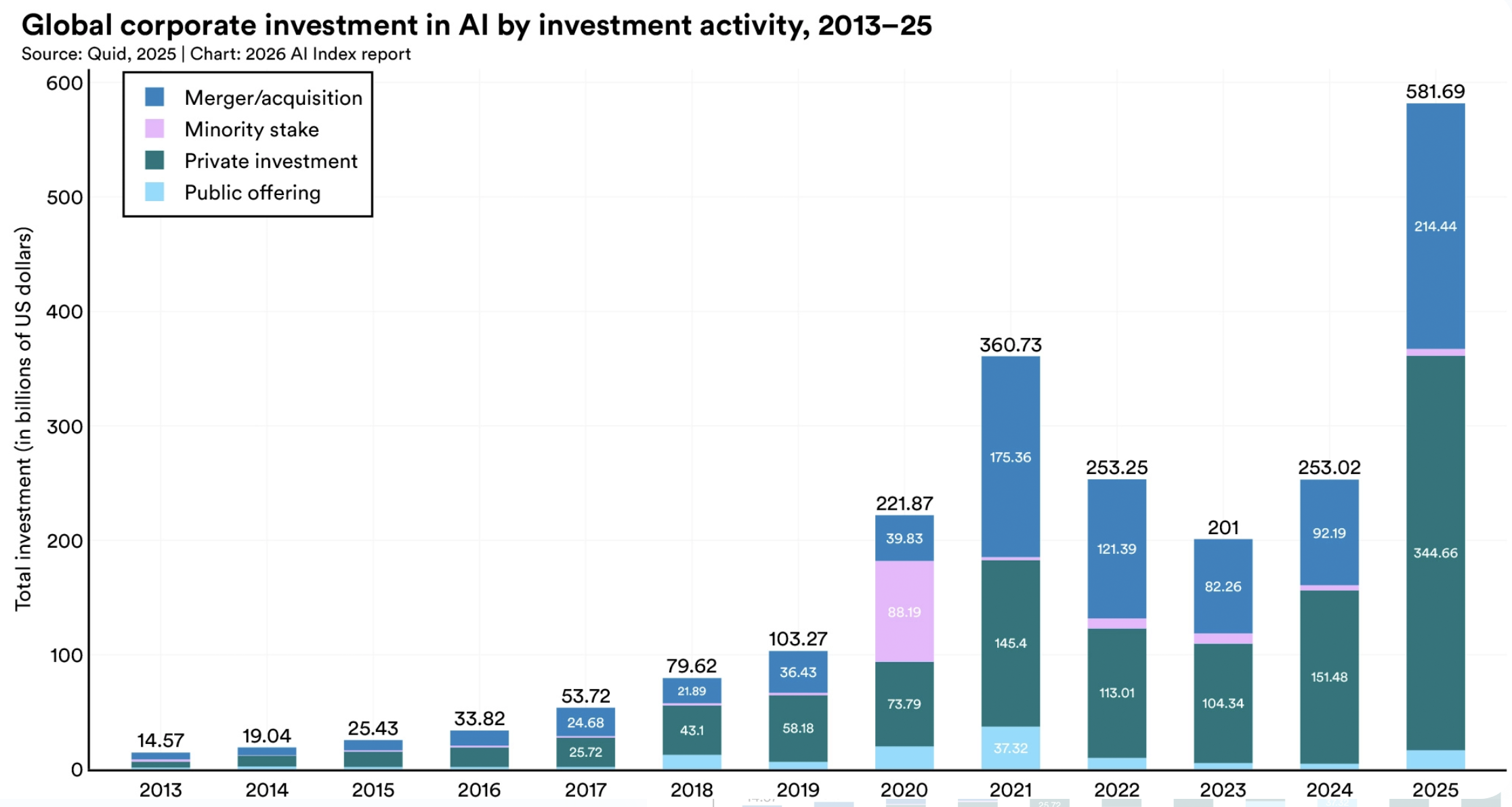

Nonostante tutte queste crepe, le aspettative di crescita, gli investimenti in Private Equity e Credit (mercati tutt'altro che trasparenti e liquidi, altra caratteristica potenzialmente allarmante!) verso queste realtà e, soprattutto, le valutazioni dei provider di chip (NVIDIA in primis, la "venditrice di pale" nell'età dell'oro) sono ai massimi storici. Tutto questo non fa altro che promettere futuro brillante, delineando tuttavia aspettative molto diverse dalla realtà attuale dei fatti e dagli attuali flussi di cassa.

Dall'altro lato, mi chiedo quanto gli utenti finali siano effettivamente disposti a pagare per una subscription premium: la maggior parte delle persone non necessita infatti di Claude Code o Gemini Pro e, di conseguenza, non è disposta a pagare decine di dollari al mese. Al contempo, tuttavia, i modelli accessibili gratuitamente mantengono un costo importante, sia di sviluppo one-off che di mantenimento che, prima o poi, qualcuno dovrà pur sostenere.

Detto ciò, non penso (e non mi auguro) che l'AI scoppierà in modo violento come è stato per la crisi delle dot-com agli inizi degli anni Duemila (le ultime parole famose!); credo (e forse spero!) che questo fenomeno si ridimensionerà, sia come hype che in termini puramente economici, finendo per farci abituare "dolcemente" a questa nuova quotidianità. Quindi, che ci piaccia o meno, meglio imparare a conviverci!

Per saperne di più

AI 2027: a dystopian story

Stanford AI report 2026

The Open AI Bubble: How Big Tech May Be Inflating Revenue

Perché stiamo usando l'AI in modo sbagliato (per ora)

Cal Newport: In Defense of Thinking